很多人看到 GPT-5.4 的热度,第一反应是“模型又强了一点”;真正和科研写作用户相关的,其实不是抽象跑分,而是它在长链路任务里的连续性更好了。无论你是在做选刊、补文献,还是让模型把一段研究背景拆成可投稿的叙述,稳定入口和可复核流程都比一次性答案更重要,这也是 chatgpt 镜像 在国内场景里更有现实价值的原因。

1. GPT-5.4 这次升级,科研用户最该看什么

从官方发布页看,GPT-5.4 把 reasoning、coding 和 agentic workflow 放进了同一条主线模型里,重点不是“说得更像人”,而是更能把复杂任务拆开、执行、再回头核验。对于科研写作用户来说,这意味着它在处理长上下文、网页检索和多步判断时更稳,不容易出现前半段分析得很好,后半段突然忘条件的情况。1

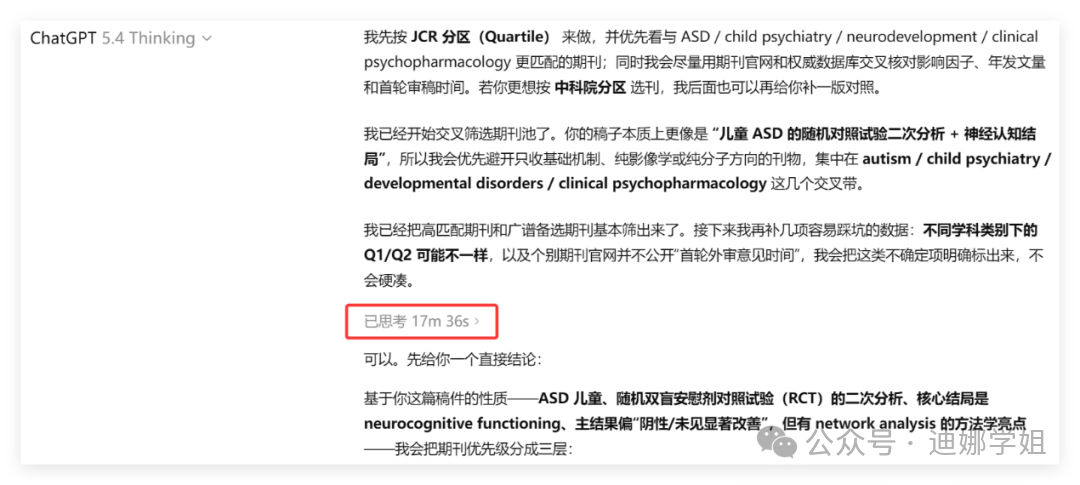

原始微信文章里最有价值的观察,不是某一句“超过谁”,而是它展示了 GPT-5.4 在学术任务里更愿意把思路摊开来做。你能看到它先匹配期刊,再补查官网数据,再决定排序依据,这种过程感会直接影响你对结果的信任度。放到 chatgpt 镜像 里使用时,这个特点更明显,因为你可以把同一轮结果交给别的模型复核,而不是被单一入口绑死。2

2. 场景一:选刊不只是列名单,而是给你一个可执行顺序

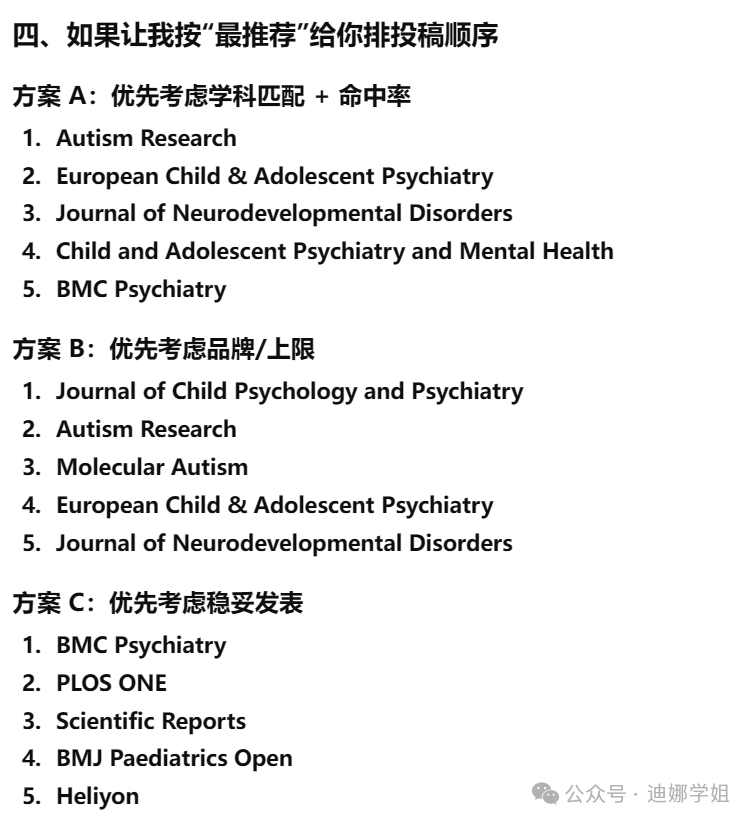

科研用户最怕的不是“没有期刊推荐”,而是推荐名单看起来很多,真正能投的却没几个。GPT-5.4 在这个场景里的进步,体现在它更像一个会做筛选的助理:先判断文章主题属于哪个交叉学科,再回到期刊官网补核分区、范围和审稿口径,最后再给投稿顺序。这样的输出对真正要投论文的人更实用,因为你接下来知道该先查谁、备谁、放弃谁。

微信原文给出的截图里,GPT-5.4 并不是直接抛一个 Top 5,而是把“学科匹配”“品牌上限”“稳妥发表”拆成三种路线。这个拆法很适合放进 chatgpt 镜像 工作流里:先让 GPT-5.4 做主排序,再让 Claude 或 Gemini 检查期刊范围描述有没有过度概括,能明显减少误投风险。

实操上,我更建议把 chatgpt 镜像 当成“选刊分诊台”来用,而不是最终裁决者。模型先给出三类期刊池,你再抽样检查 3 到 5 本期刊官网的 scope、article type 和近两年同主题论文。如果抽查结果一致,说明这轮推荐可进入下一步;如果偏差很大,就把错误样本回贴给模型重排,比整轮推翻更省时间。

这一步可以做得更细一点。你完全可以给自己设一个“过线标准”:只要模型推荐的前 3 本期刊里,有 2 本在 scope、研究对象和文章类型上都能通过官网验证,这轮结果就保留;如果连 1 本都对不上,就不继续改提示词,而是先补充摘要、研究对象或方法学关键词。很多人觉得模型不准,实际问题往往是输入太粗。把这套标准固定下来,chatgpt 镜像 才会真正从“能回答问题”升级成“能协助你做判断”。

3. 场景二:选题分析更透明,适合做研究切口复核

很多选题失败,不是因为研究方向错,而是切口太宽、变量太散、故事线不够收束。GPT-5.4 在这个环节的优势,是它更愿意把“为什么这样拆”说出来。你给它一段摘要、几篇核心参考文献和目标期刊,它往往会先判断题目落点,再解释哪些变量值得保留,哪些词会让投稿方向跑偏。这个过程对科研新手尤其有用,因为你不只拿到一个标题,而是拿到一套收缩选题的依据。

把这个环节放在 chatgpt 镜像 里做还有一个好处:你可以把 GPT-5.4 的分析过程交给备用模型挑刺。像 Write360 多模型入口 这类平台,适合拿来做第二视角复核;如果你临时遇到线路波动,aicnbox.com 也能当备用入口,避免研究流程卡在登录或切模上。

这里要注意一个边界:chatgpt 镜像 很适合帮你缩窄选题、生成比较框架和补核公开信息,但不该替你拍板实验设计。更稳的做法是让模型输出“推荐保留变量”“建议删除变量”“必须人工确认的信息源”三个清单,你再据此做导师沟通。这样用,GPT-5.4 会像一个合格的研究助理;反过来如果把它当审稿人或 PI,风险就会立刻放大。

4. 场景三:润色依然有价值,但不是 GPT-5.4 最拉开差距的地方

很多人会把新模型第一时间拿去跑润色,原因很简单,见效快、反馈也直观。但从这次实测看,润色并不是 GPT-5.4 和旧版本差距最大的地方。语言更顺、句式更自然当然重要,可只要任务仍然属于单轮改写,模型代际差距不会像“查资料 + 判断 + 重组结构”那样夸张。

这对 chatgpt 镜像 用户反而是个好消息,因为你没必要把所有润色任务都压到最高规格模型。更现实的方案是:结构重写、选刊、补文献这类重任务交给 GPT-5.4;纯语言打磨、摘要压缩、cover letter 微调则交给你更顺手的模型。像 Gemini Tool 这类入口,适合在需要做风格改写或多版本比较时补位。

也就是说,chatgpt 镜像 的价值不在“所有任务都上最强模型”,而在于你能把模型放到最合适的位置。只要把任务拆清楚,成本、速度和质量往往能同时兼顾。

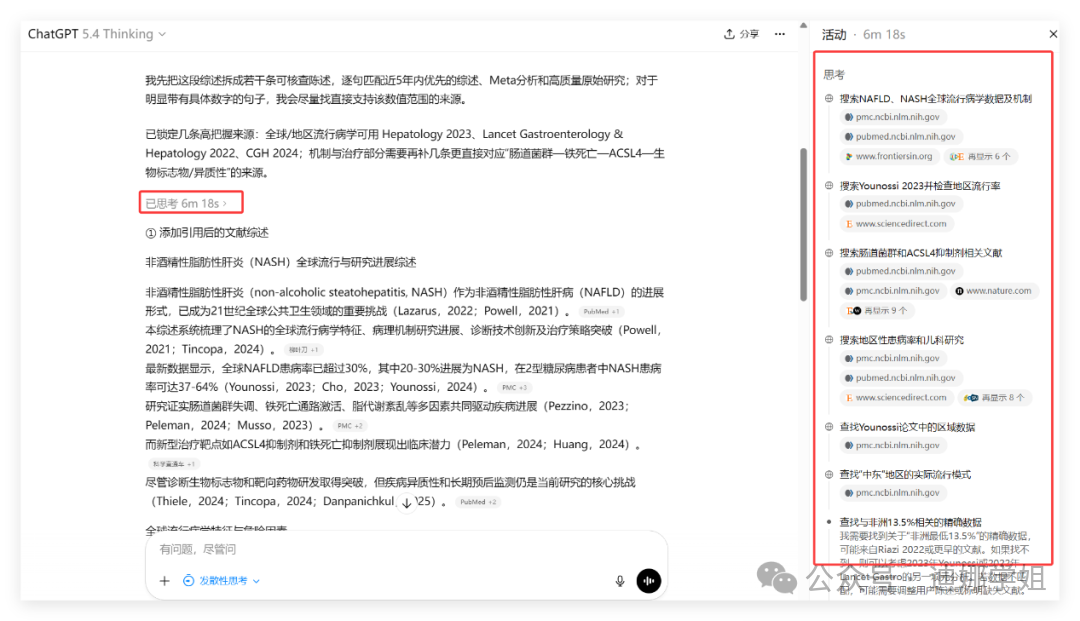

5. 场景四:补文献和证据链,GPT-5.4 的提升最实用

原文里最打动我的部分,其实是文献综述补充。GPT-5.4 不只是多给几条参考文献,而是更愿意按句子去找支撑来源,并把检索路径亮出来。对于需要补 discussion、introduction 或 disease burden 段落的人来说,这种能力比“写得像不像人”重要得多,因为真正耗时间的是找依据,不是改措辞。1

官方发布页也提到 GPT-5.4 在深度网页研究和工具使用上继续提升,BrowseComp 成绩高于 GPT-5.2,说明它在高特异性查询上更能持续维持上下文。1 这和 chatgpt 镜像 的组合很自然:主模型负责搜和串,备用模型负责查漏。你甚至可以把一段综述拆成 5 句话,让 GPT-5.4 逐句配文献,再让另一个模型只检查 PMID、年份和期刊名是否对得上。

如果你经常做证据补全,我建议固定一条 chatgpt 镜像 流程:第一轮让 GPT-5.4 输出“待补句子 + 推荐文献 + 选择理由”,第二轮只抽查高风险句,第三轮再统一格式化参考文献。这样模型真正承担的是资料搜集和初筛,而最终责任仍在你手里,风险和效率会更平衡。

6. 国内如何用 chatgpt 镜像 跑这四类任务

对国内用户来说,能不能稳定打开、能不能切模型、能不能留住历史记录,往往比跑分高低更先决定体验。科研写作又属于典型长任务,一次会话里经常要反复上传摘要、改标题、补文献、查投稿范围,所以我不建议把入口问题留到任务开始后再解决。更稳的做法,是提前准备一个主入口和两个备用入口,让 chatgpt 镜像 真正承担工作台角色。

| 入口 | 适合做什么 | 什么时候用 |

|---|---|---|

| AIMirror GPT 中文站 | 主力跑 GPT-5.4、Claude、Gemini 多模型并行 | 日常科研写作、选刊、补文献、长任务留档 |

| Write360 多模型入口 | 轻量复核、快速切换不同模型 | 需要第二视角确认时 |

| Grok 中文镜像 | 补实时讨论或看更偏互联网语境的回答 | 需要横向比较输出风格时 |

| aicnbox.com | 作为镜像站集合备用 | 主线路波动、临时找替代入口时 |

如果你已经习惯用 chatgpt 镜像 跑日常任务,可以把科研流程写成固定顺序:先在主站完成首轮分析,再在备用站做风险复核,确认后才导出最终文本。这个顺序听起来多一步,但它能显著减少“模型回答很像对,细节却错了”的返工。

我建议你把每次科研任务都留一份极简记录:用了哪个入口、主模型是谁、哪些字段已经人工复核、哪些信息还待确认。记录不需要复杂,哪怕只是一个 Markdown 清单,也足够让你下次复现同类任务。长期看,这比反复追逐“哪家模型今天更强”更有用,因为科研写作真正消耗你的,往往是重复检查和版本回滚,而不是第一次出稿本身。

7. 两套能直接上手的提示词

下面这两段模板,适合放在 chatgpt 镜像 里反复复用。它们的重点不是把提示词写得多花,而是强制模型先给判断标准,再给答案,这样你后续更容易抽查。

你现在是科研选刊助手。请根据我提供的摘要、研究对象、主要终点和目标分区,输出:

1. 学科最匹配的 5 本期刊;

2. 每本期刊的推荐理由;

3. 不确定的信息项;

4. 我必须回到官网人工确认的字段。

如果信息不足,请明确指出缺什么,不要自行编造。

请逐句检查下面这段综述,为每一句补充 1 到 3 条最相关的英文文献,并输出:

1. 原句;

2. 推荐文献;

3. 选择理由;

4. 需要人工复核的风险点。

要求优先使用近 5 年高质量来源,无法确认时直接标注“待人工确认”。

真正用起来时,我建议你把这两段模板固定在 AIMirror GPT 中文站 里作为常用提示词,再按任务难度决定是否切到别的 chatgpt 镜像 做复核。这样做的好处很直接:你不会每次都从头解释背景,也更容易看出新模型到底是哪里变强了。

如果你最近正准备投稿,最值得马上试的一步不是盯着参数表,而是拿自己手头那段最耗时间的任务去跑一次。把选刊、选题、润色、补文献拆开,分别在主入口和备用入口里做对照,你很快就会知道 GPT-5.4 值不值得进入长期流程。想省去线路折腾,直接从 AIMirror GPT 中文站 开始最省事;如果你需要多站点容灾,再把 Write360 和 aicnbox 补进书签就够了。跑完记得留一版人工复核结论。